בינה מלאכותית במוזיקה

בינה מלאכותית במוזיקה (באנגלית: Artificial Intelligence in Music) הוא תחום מחקר, פיתוח ויצירה המשלב בין מוזיקולוגיה, תורת המוזיקה, הנדסת קול ומדעי המחשב. התחום עוסק בשימוש באלגוריתמים ובמערכות ממוחשבות לצורך הלחנה, ביצוע, עיבוד, ניתוח והפקה של יצירות מוזיקליות. אף על פי שמקובל לזהות את התחום עם טכנולוגיות מודרניות, שורשיו הרעיוניים נעוצים עוד במאה ה-19, בחזונה של עדה לאבלייס לגבי "המנוע האנליטי", ואף קודם לכן בניסיונות ליצירה אלגוריתמית כדוגמת "משחק הקוביות המוזיקלי" המיוחס למוצרט.

ראשיתו המעשית של התחום בעידן המחשב החלה בשנות ה-50 של המאה ה-20, עם יצירת "סוויטת איליאק" (אנ') (1957) – היצירה הראשונה שהולחנה במלואה על ידי מחשב. לאורך השנים התפתחו השיטות בתחום ממערכות מבוססות חוקים (Rule-Based) ומודלים סטטיסטיים כגון שרשראות מרקוב, לשימוש בטכנולוגיות מתקדמות של למידה עמוקה ובינה מלאכותית יוצרת. מערכות מודרניות אלו מאומנות על מאגרי נתונים עצומים ("Big data") ומסוגלות לזהות דפוסים מורכבים ולייצר תכנים חדשים – החל ממלודיה והרמוניה ועד לשירה ועיבוד מלא – על בסיס הנחיות טקסטואליות.

נכון לשנת 2025, הבינה המלאכותית משתלבת במגוון היבטים של העשייה המוזיקלית, בהם הלחנה אוטומטית, ליווי וביצוע בזמן אמת, מיקסינג ועיצוב סאונד, וכן שחזור וחיקוי קול אנושי. לצד הפריחה הטכנולוגית והדמוקרטיזציה של היצירה המוזיקלית, התחום מעורר סוגיות משפטיות ואתיות כבדות משקל. הדיון הציבורי מתמקד בשאלת הבעלות על זכויות יוצרים ביצירות שנוצרו על ידי מכונה, השימוש ביצירות מוגנות לצורך אימון המודלים, והחשש מהשפעה שלילית על פרנסתם ומעמדם של מוזיקאים ומפיקים אנושיים.

היסטוריה והתפתחות

שנות ה-50 וה-60: התחלות מוקדמות

ההיסטוריה של השימוש במחשבים ליצירת מוזיקה מתחילה כמעט במקביל להמצאת המחשב עצמו, ואף נחזתה תיאורטית עוד קודם לכן. שנות ה-50 וה-60 היוו את "תור הזהב" הראשון של התחום, בו נעשו הניסויים החלוציים באלגוריתמים מתמטיים ונוצרו היצירות הממוחשבות הראשונות.

עוד לפני שנבנה המחשב הראשון, עדה לאבלייס (הנחשבת למתכנתת הראשונה) חזתה ב-1843 כי "המנוע האנליטי" של צ'ארלס בבג' יוכל יום אחד לפעול על דברים שאינם מספרים בלבד. היא כתבה כי אם ניתן יהיה לבטא את היחסים בין צלילים ובהרמוניה כפעולות מופשטות, המנוע יוכל ”להלחין קטעי מוזיקה מדעיים ומורכבים בכל דרגה של מורכבות”.[1][2] כמו כן, הרעיון של שימוש באלגוריתמים ואקראיות במוזיקה היה קיים ב"משחקי קוביות מוזיקליים" (כמו זה של מוצרט), אך המחשב אפשר ליישם רעיונות אלו בקנה מידה חדש.[1]

היצירה המשמעותית ביותר שמסמנת את לידת התחום היא "סוויטת איליאק" (אנ'), שהושלמה ב-1956 ופורסמה ב-1957.[1][3] היצירה הולחנה על ידי הכימאי והמלחין לז'רן הילר (אנ') ולאונרד אייזקסון (אנ') באוניברסיטת אילינוי.[1][3] הם השתמשו במחשב ILLIAC I (אנ'), אחד המחשבים הראשונים שנבנו.[1] התכנות נעשה בקוד בינארי.[3] הילר ואייזקסון השתמשו בשיטות סטטיסטיות וכללים מובנים. היצירה עשתה שימוש ב"שרשראות מרקוב" ובטכניקות של "הילוך מקרי" ליצירת גובהי הצליל.[3] בפרק הראשון והשני של הסוויטה, המחשב תוכנת לפעול לפי כללי הקונטרפונקט המסורתיים כדי לייצר את המוזיקה.[1] זוהי היצירה הראשונה המוכרת שהולחנה בעזרת מחשב.[1][3] הילר נתפס כחלוץ בתחום, שטען כי אם הפלט של האלגוריתם אינו מספק, יש לשנות את התוכנה ולהריץ אותה מחדש, גישה המאפיינת את המעבר מהלחנה של תו-אחר-תו להלחנה של תהליכים. בזמנו, היצירה והמאמר שפורסם בסיינטיפיק אמריקן ב-1959 עוררו עוינות רבה בעולם המוזיקה המסורתי, והילר תויג כ"כימאי לשעבר" שאין לו הבנה במוזיקה.[3]

במקביל או מעט לפני "סוויטת איליאק", נערכו ניסויים נוספים שהתבססו על מודלים סטטיסטיים – ריצ'רד סי. פינקרטון בנה ב-1956 מודל מרקוב מסדר ראשון שנקרא "Banal Tune-Maker". המערכת אומנה על 39 שירי ילדים והצליחה לייצר מנגינות חדשות שנשמעו כמו שירי ילדים, באמצעות תהליך של הילוך מקרי.[1] חוקרים אחרים ערכו ניסויים עם מודלים של מרקוב מסדרים שונים (מ-1 עד 8) שהתבססו על מאגר של 37 מזמורי תפילה. הם גילו כי מודלים מסדר נמוך יצרו מוזיקה אקראית יותר, בעוד שמודלים מסדר גבוה נטו לחזור על קטעים מהיצירות המקוריות.[4] כבר בשלב מוקדם זה, התחום הגיע גם לחובבים באמצעות "Geniac Electric Brain", ערכה לבנייה עצמית שאפשרה למשתמשים ליצור "מנגינות אוטומטיות".[3]

בשנות ה-60, המלחין יאניס קסנאקיס לקח את השימוש במתמטיקה ובמחשבים לכיוון חדש, אותו כינה "מוזיקה סטוכסטית". קסנאקיס ראה את השימוש במחשב ככלי המאפשר למלחין להיות מעין "טייס" המנווט בחלל של צלילים. הוא השתמש בנוסחאות מפיזיקה, כגון התאוריה הקינטית של הגזים, כדי לשלוט בהתנהגות של "ענני צליל", שבהם כל תו הוא אנלוגיה לחלקיק גז. ביצירה "Analogique A", קסנאקיס השתמש במודלים סטטיסטיים (מרקוב) כדי לקבוע את סדר הקטעים המוזיקליים.[1] הוא פיתח את "תוכנית המוזיקה הסטוכסטית" (SMP) והשתמש במחשב IBM 7090 (אנ') כדי להלחין יצירות כמו ST/10 ו-Atrées (ב-1962), אם כי לעיתים קרובות הוא ערך ושינה את הפלט הממוחשב ידנית.[3]

שנות ה-80 וה-90: עידן מערכות המומחה

בשנות ה-80 וה-90 חל שינוי משמעותי בתחום הבינה המלאכותית במוזיקה. אם שנות ה-50 וה-60 התאפיינו במודלים סטטיסטיים ואקראיות (כמו שרשראות מרקוב), העשורים הללו התאפיינו בעלייתן של מערכות מומחה וגישות מבוססות ידע. החוקרים הבינו שכדי לפתור בעיות מורכבות, המחשב זקוק ל"ידע מוקדם" המקודד לתוכו, בדומה לזה של מומחה אנושי.[5]

אחת הדמויות הבולטות והמשפיעות ביותר בתקופה זו הייתה המלחין דייוויד קופ. קופ החל את פרויקט "ניסויים בבינה מוזיקלית" (באנגלית: "Experiments in Musical Intelligence", ידוע גם בתור EMI) בשנת 1981. הטריגר לפיתוח התוכנה היה דווקא "מחסום כתיבה" של קופ עצמו. המטרה הראשונית הייתה ליצור תוכנה שתלמד את סגנון ההלחנה האישי שלו, כך שבכל נקודה נתונה הוא יוכל לבקש מהמחשב להציע את "התו הבא" או "התיבה הבאה". בניסויים מאוחרים יותר, קופ הרחיב את היריעה ואימן את התוכנה לחקות סגנונות של מלחינים אחרים מהקאנון הקלאסי, כגון באך ומוצרט.[1] הגישה של קופ התבססה על קונספט של "רקומבינציה". התוכנה מנתחת יצירות קיימות, מפרקת אותן למרכיבים, ויוצרת מוזיקה חדשה על ידי שילוב מחדש של אלמנטים אלו בהתאם לכללים סגנוניים. שיטה זו נחשבת לדטרמיניסטית יותר בהשוואה לשיטות הסטוכסטיות המוקדמות.[3] המוזיקה שהולחנה באמצעות הפרויקט נחשבה למוצלחת למדי, והוכיחה כי ניתן לייצר יצירות חדשות המחקות באופן משכנע סגנונות היסטוריים מובהקים.[1]

במקביל לקופ, חוקרים נוספים בשנות ה-80 וה-90 פיתחו מערכות שנועדו לפתור בעיות מוזיקליות ספציפיות באמצעות כללים מוגדרים מראש (אנ') ודקדוקים גנרטיביים. כמאל אבג'יוגלו פיתח ב-1988 מערכת מומחה להרמוניזציה של כוראלים מאת יוהאן סבסטיאן באך. המערכת השתמשה בלוגיקה מסדר ראשון וכללה מאות כללים ("חוקי הפקה", אילוצים ויוריסטיקות) כדי לייצר הרמוניות שלא הפרו את חוקי הולכת הקולות המסורתיים. מארק ג'יי. סטידמן (אנ') חקר את הבלוז (בלוז 12 תיבות) והגדיר סט קטן של חוקים המבוססים על דקדוק גנרטיבי. המטרה הייתה לייצר מהלכי אקורדים מוכרים ווריאציות עליהם, גישה שהייתה רלוונטית במיוחד לאלתור ג'אז.[1] נעשה שימוש ברשתות של אילוצים כדי לייצג יחסים מוזיקליים. במודלים אלו, המערכת מנסה למצוא פתרון (כגון מלודיה או רצף אקורדים) העומד בכללים שהוגדרו מראש (למשל, שצליל מסוים חייב להיות חלק מהאקורד המנוגן).[2]

שנות ה-2000 ואילך: המעבר ללמידת מכונה

שנות ה-2000 ואילך מסמנות תפנית חדה בהתפתחות הבינה המלאכותית במוזיקה: המעבר מ"מערכות מומחה" המבוססות על חוקים שהוגדרו ידנית, אל עבר למידת מכונה ולמידה עמוקה. בתקופה זו, המחשב הפסיק להיות רק כלי המבצע הוראות והפך למערכת לומדת, המנתחת כמויות עצומות של נתונים כדי להסיק מסקנות ולייצר תוצרים חדשים.

בעוד ששיטות סטטיסטיות (כמו שרשראות מרקוב) שלטו בעשורים הקודמים, שנות ה-2000 הביאו עמן שימוש נרחב ברשתות נוירונים המסוגלות ללמוד דפוסים מורכבים יותר. כבר בסוף שנות ה-80 ותחילת ה-90 נעשו ניסיונות ראשונים (כמו המודל של Todd ב-1989), אך הפריצה המשמעותית התרחשה עם פיתוח ארכיטקטורות המסוגלות לזכור הקשרים ארוכי-טווח. בשנת 2002, החוקרים דאגלס אק ויורגן שמידהובר (אנ') הדגימו שימוש ברשתות LSTM (אנ') ליצירת מוזיקה. בניגוד למודלים קודמים שהתקשו לשמור על מבנה הגיוני לאורך זמן, רשתות אלו הצליחו ללמוד מבנים של בלוז ואלתור, תוך שמירה על הקשר הרמוני וריתמי לאורך זמן רב יותר.[1] שיטות כמו RBM (מכונת בולצמן מוגבלת (אנ')) שימשו למידול פוליפוניה מורכבת, כפי שהדגים ניקולא בולנז'ה-לבנדובסקי ועמיתיו ב-2012, מה שאפשר יצירת מרקמים מוזיקליים עשירים יותר.[1]

התחום, שהיה נחלתם של חוקרים באקדמיה, משך את תשומת ליבן של חברות הענק, שהקימו מעבדות מחקר ייעודיות – "פרויקט מג'נטה" של גוגל הוכרז כפרויקט מחקר שמטרתו לקדם את הבינה המלאכותית ביצירת מוזיקה ואומנות. הפרויקט, המבוסס על ספריית TensorFlow, פיתח כלים כמו Music טרנספורמר שאפשרו יצירת מוזיקה עם מבנה ארוך-טווח ומשכנע יותר. המעבדה של "מעבדות מדעי המחשב של סוני" (באנגלית: "Sony CSL") בפריז פיתחה את הכלי "Flow Composer". דוגמה בולטת ליכולותיו הייתה תזמור מחדש של "האודה לשמחה" בסגנונות שונים, כגון זה של הביטלס או באך, תוך שימוש במודלים של אנטרופיה מקסימלית.[1] אחת היצירות המפורסמות שיצאו ממעבדה זו היא השיר "Daddy's Car" (2016), שנוצר בסגנון הביטלס ועבר הפקה ומיקס על ידי מוזיקאים אנושיים.[6]

בשנים שלאחר מכן חל שינוי דרמטי נוסף: המעבר מיצירת ייצוגים סמליים (כגון תווי MIDI) ליצירה ישירה של אודיו גולמי (אנ'), כולל שירה וביצוע אינסטרומנטלי מלא. בשנת 2020 הציגה OpenAI את "Jukebox", מודל גנרטיבי שאומן על מאגר עצום של שירים. "Jukebox" היה מסוגל לייצר שירים מלאים, כולל שירה ומילים, תוך חיקוי סגנונות של אמנים ספציפיים (כמו אלביס פרסלי או פרנק סינטרה). למרות איכות השמע שהייתה לעיתים רועשת, המודל הדגים יכולת חסרת תקדים ללמוד ולחקות סגנונות ווקאליים ואינסטרומנטליים מורכבים.[7] המודלים Suno ו-Udio מייצגים את חזית הטכנולוגיה הנוכחית (2024–2025). הם מאפשרים למשתמשים ליצור שירים מלאים, ברמת הפקה אולפנית, באמצעות הנחיות טקסט בלבד. מודלים אלו מתבססים לרוב על ארכיטקטורות טרנספורמר (בדומה ל-ChatGPT) ו-Diffusion (בדומה ל-DALL-E), המאפשרות להם להבין הקשרים סמנטיים בטקסט ולתרגם אותם לאותות אודיו מורכבים.[5]

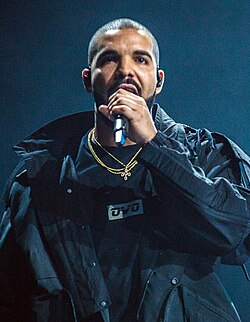

לצד ההתלהבות, הטכנולוגיה החדשה מציבה אתגרים משמעותיים. מחקרים שהופצו בשנת 2025 הראו שמודלים גנרטיביים מותירים לעיתים "חתימה" ייחודית בספקטרום התדרים של המוזיקה, מעין עליות קטנות בתדרים הנובעות משכבות הדה קונבולוציה במודל. תופעה זו, המכונה לעיתים "אפקט לוח השחמט", מאפשרת לזהות באופן טכני האם יצירה נוצרה על ידי AI, גם אם היא נשמעת אנושית לחלוטין לאוזן.[8] היכולת לחקות במדויק קולות של אמנים הובילה לשערוריות, כמו במקרה שבו הראפר דרייק השתמש בבינה מלאכותית כדי לחקות את טופאק וסנופ דוג. חברות התקליטים הגדולות (כמו יוניברסל וסוני) ניהלו תביעות ענק נגד חברות כמו Suno ו-Udio בטענה שהן אימנו את המודלים שלהן על מוזיקה מוגנת ללא רשות.[9]

טכנולוגיות ושיטות

מערכות מבוססות חוקים

מערכות מבוססות חוקים (אנ') מייצגות את אחד השלבים המרכזיים וה"קלאסיים" בהתפתחות הבינה המלאכותית במוזיקה. בגישה זו, המחשב אינו "לומד" לבד מתוך האזנה לדוגמאות (כפי שקורה בלמידת מכונה מודרנית), אלא מתכנתים ומוזיקאים מקודדים לתוכו באופן מפורש את הידע התאורטי והחוקים של הסגנון המוזיקלי הרצוי. המחשב פועל כ"סוכן" המבצע הוראות לוגיות מדויקות של "עשה ואל תעשה".[1]

התחומים במוזיקה שהכי התאימו לגישה זו הם אלו שיש להם חוקים נוקשים וברורים, ולכן קל לנסח אותם בשפת מחשב – קונטרפונקט זהו סגנון כתיבה רב-קולי בעל חוקים מחמירים (כגון איסור על תנועה במרווחים מקבילים מסוימים). הספר המפורסם "גראדוס אד פארנאסום" מאת יוהאן יוזף פוקס (1725), המגדיר את חוקי הקונטרפונקט, שימש בסיס למערכות רבות. החוקים תורגמו לאלגוריתמים שבודקים כל צעד מוזיקלי. היצירה הראשונה, "סוויטת איליאק" (1957) של הילר ואייזקסון, השתמשה בחוקי קונטרפונקט כדי לייצר את הפרקים הראשון והשני שלה. מאוחר יותר, דייוויד קופ פיתח תוכנה בשם "Gradus" שלמדה ויישמה חוקים ליצירת קונטרפונקט.[1] חוקרים כמו טורסטן אנדרס פיתחו מערכות כמו "Strasheela", המשתמשות ב"תכנות אילוצים". במקום לכתוב הוראות ישירות ליצירה, המערכת מקבלת סט של מגבלות (למשל: "אסור ששני קולות יזוזו בקווינטות מקבילות"), והמחשב מחפש פתרון מתמטי שעומד בכל האילוצים הללו.[10] בנוסף, אחת הבעיות הקלאסיות היא כתיבת ליווי הרמוני למנגינה נתונה (סופרן) בסגנון של יוהאן סבסטיאן באך. כמאל אבג'יוגלו פיתח את אחת המערכות המרשימות בתחום זה. הוא יצר "מערכת מומחה" שכללה כ-350 חוקים לוגיים ("חוקי הפקה", אילוצים ויוריסטיקות). המערכת ידעה להתבונן במנגינה ולייצר לה שלושה קולות ליווי (אלט, טנור, בס) תוך שמירה על כללי הולכת הקולות הקפדניים של באך.[1]

שיטה נוספת היא דקדוקים גנרטיביים. בשיטה זו, מוזיקה נתפסת כשפה בעלת תחביר. החוקרים מגדירים "דקדוק" – סט של חוקים המגדיר אילו רצפים של אקורדים או תווים הם "חוקיים" ואילו לא, בדומה לאופן שבו בלשנות מגדירה משפטים בשפה.[1] החוקר מארק ג'יי. סטידמן (אנ') פיתח דקדוק גנרטיבי לבלוז (בלוז 12 תיבות). הוא הגדיר קבוצה קטנה של חוקים שאפשרו למחשב לייצר מהלכי אקורדים בסיסיים וגם "תחליפים" מורכבים יותר, האופייניים לאלתור ג'אז, תוך שמירה על ההיגיון ההרמוני של הסגנון. גישות אלו שימשו לא רק ליצירה אלא גם לניתוח (אנליזה) ממוחשב של מוזיקה, כמו עבודתו של טרי וינוגרד (אנ') שהשתמש בדקדוקים מערכתיים לניתוח הרמוני.[1][11]

מערכות לינדנמאייר (אנ') (באנגלית: L-system) הן דוגמה לשיטה מבוססת חוקים דטרמיניסטית, שבמקור נועדה למדל צמיחה של צמחים בביולוגיה. המערכת מתחילה מגרעין בסיסי ומפעילה עליו חוקי "שכתוב" (אנ'). למשל: "כל פעם שמופיע A, החלף אותו ב-AB". תהליך זה יוצר מבנים מורכבים בעלי דמיון עצמי (אנ'). מלחינים כמו הנספטר קיבורץ ומייקל אדוארדס השתמשו בשיטה זו כדי לייצר חומרים מוזיקליים המתפתחים בצורה אורגנית ומובנית, כאשר המספרים שנוצרים על ידי המערכת מתורגמים לתווים, מקצבים או דינמיקה.[3]

מערכות אלו מצטיינות בחיקוי סגנונות שהתאוריה שלהם מוגדרת היטב (כמו מוזיקת בארוק). הן מאפשרות שליטה גבוהה והבנה ברורה של "למה המחשב בחר בתו מסוים". אך למרות זאת, הגדרת החוקים היא משימה קשה ומייגעת. סגנונות מוזיקליים רבים הם מורכבים מדי או "פרוצים" מדי מכדי שניתן יהיה לנסח אותם כקבוצה סגורה וסופית של חוקים לוגיים. בנוסף, מערכות אלו לעיתים מייצרות מוזיקה שנשמעת "נכונה" טכנית ("תקנית"), אך חסרת מעוף או רגש, מכיוון שהן מתקשות לחרוג מהחוקים באופן יצירתי כפי שעושה מלחין אנושי.[1]

למידת מכונה

ערך מורחב – למידת מכונה

ערך מורחב – למידת מכונה

המעבר ללמידת מכונה סימן את שינוי הפרדיגמה המשמעותי ביותר בתולדות המוזיקה הממוחשבת. אם בעבר המחשב פעל לפי חוקים שהוזנו לו ידנית על ידי בני אדם, הרי שבגישה זו המחשב "לומד" בעצמו את החוקים, הסגנון והמבנה מתוך ניתוח סטטיסטי של מאגרי נתונים (קורפוס טקסט (אנ')) עצומים של מוזיקה קיימת.[1][5]

בגישה זו, המערכת מנתחת אוסף יצירות כדי לחלץ מאפיינים סטטיסטיים. המודל לומד את ההסתברות להופעת תו מסוים, אקורד, או משך צליל, בהינתן מה שקדם לו. המודלים של מרקוב (אנ') היו מאבני היסוד של השיטה הסטטיסטית. מודלים אלו "לוכדים" את ההסתברות למעבר בין מצבים מוזיקליים. מודל מרקוב מסדר נמוך מייצר מוזיקה אקראית יותר, בעוד שמודל מסדר גבוה נוטה לחזור על קטעים מהיצירות המקוריות עליהן אומן. החל משנות ה-80 המאוחרות, וביתר שאת משנות ה-2000, החל השימוש ברשתות נוירונים המנסות לחקות את אופן הלמידה של המוח האנושי. רשתות אלו מסוגלות ללמוד קשרים מורכבים יותר מאשר מודלים סטטיסטיים פשוטים.[1]

אחד האתגרים הגדולים במוזיקה הוא ה"מבנה ארוך הטווח" – היכולת לזכור מוטיב מתחילת היצירה ולחזור אליו בסופה. רשתות נוירונים רגילות התקשו בכך. בשנת 2002, החוקרים דאגלס אק ויורגן שמידהובר (אנ') הדגימו שימוש ברשתות LSTM (אנ'), סוג של רשת עצבית רקורסיבית בעלת "זיכרון". רשתות אלו הצליחו ללמוד מבנים של בלוז ואימפרוביזציה ולשמור על הקשר מוזיקלי לאורך זמן רב יותר. מודלים של RBM (מכונת בולצמן מוגבלת (אנ')) שימשו למידול של פוליפוניה מורכבת, כפי שהדגים ניקולא בולנז'ה-לבנדובסקי ועמיתיו ב-2012.[1]

היכולת לעבד נתונים בהיקף עצום הובילה לכניסת שחקנים חדשים למגרש, שהפכו את התחום מניסוי אקדמי למוצר מסחרי. "גוגל מג'נטה" הוא פרויקט מחקר של גוגל שהוכרז במטרה לקדם את מצב האומנות (אנ') בבינה מלאכותית למוזיקה ואמנות. הפרויקט השתמש בספריית TensorFlow ופיתח מודלים ליצירת מוזיקה עם מבנה משכנע. מעבדות סוני בפריז פיתחו כלים שאפשרו, למשל, לתזמר מחדש את "האודה לשמחה" בסגנונות שונים (כמו של הביטלס), על בסיס מודלים שלמדו את הסגנונות הללו מתוך נתונים קיימים.[1] דוגמה נוספת היא הסטארטאפ הבריטי "Jukedeck" (שנרכש ב-2019 על ידי ByteDance, הבעלים של טיקטוק) שהשתמש ברשתות נוירונים כדי לאפשר למשתמשים ליצור מוזיקת רקע מקורית ונטולת תמלוגים לווידאו. הטכנולוגיה למדה תורת מוזיקה (תווים, אקורדים) מתוך נתונים כדי להחליט מהו התו הבא הסביר ביותר.[12][13]

משנת 2020 ואילך, התחום עבר מיצירת תווים (MIDI) ליצירה ישירה של אודיו, כולל שירה ומילים, באמצעות ארכיטקטורות כמו טרנספורמרים ומודלי דיפוזיה. מודלים אלו, כמו Suno ו-Udio, מאומנים על כמויות עצומות של הקלטות. הם מאפשרים למשתמש להקליד טקסט ("פרומפט") ומייצרים שיר מלא, כולל שירה ריאליסטית ועיבוד.[9][8] היכולת שלהם מבוססת על למידה עמוקה, שבה המודל מנתח סטטיסטית אלמנטים בדידים במוזיקה ומקצה להם משקלים, ללא חוקים שנכתבו מראש על ידי מתכנתים.[9] דוגמה נוספת היא "Jukebox", מודל של OpenAI משנת 2020 שהיה מהראשונים להדגים יצירת אודיו גולמי (אנ') ברמה גבוהה, תוך יכולת לחקות סגנונות של זמרים ספציפיים.[1][7] "MEGAMI" היא דוגמה למערכת עדכנית (2025) המשתמשת במודלי דיפוזיה לא ליצירת המוזיקה מאפס, אלא לביצוע מיקסינג אוטומטי. המערכת לומדת את התפלגות המיקסים המקצועיים מתוך דאטה-סטים של שירים ומחילה אפקטים על ערוצים נפרדים.[14]

המעבר ללמידת מכונה יצר "קופסה שחורה", בניגוד למערכות מבוססות חוקים שבהן ידענו מדוע המחשב בחר תו מסוים, במערכות למידה עמוקה התהליך הוא סטטיסטי ופחות שקוף.[15] כמו כן, השימוש ב"דאטה-סטים עצומים" הוביל לתביעות משפטיות מצד חברות תקליטים, הטוענות שאימון המודלים (כמו של Suno ו-Udio) על שירים מוגנים בזכויות יוצרים ללא רשות מהווה הפרת זכויות יוצרים.[16][9]

רשתות נוירונים עמוקות

רשת עצבית רקורסיבית / LSTM

ערך מורחב – רשת עצבית רקורסיבית

ערך מורחב – רשת עצבית רקורסיבית

רשתות עצביות רקורסיביות (באנגלית: RNN - Recurrent Neural Networks) נבנו במיוחד לייצוג של רצפים, והן כוללות חיבורים מעגליים בין הצמתים היוצרים מבנה של זיכרון. השימוש הראשון ברשתות אלו למוזיקה נעשה בסוף שנות ה-80, כאשר המערכת פלטה תו אחד (גובה צליל) בכל פעם כדי ליצור קו מלודי. עם זאת, רשתות RNN רגילות התקשו באימון על תלויות ארוכות טווח, מה שהוביל לחוסר קוהרנטיות במבנה הכולל של היצירה.[1]

כדי לפתור זאת, פותחה ארכיטקטורת ה-LSTM (אנ') בשנת 1997, אשר הציגה מבנה זיכרון בתוך הצמתים של הרשת. מודלים מבוססי LSTM מסוגלים ללמוד מבנים מוזיקליים טוב יותר ולטפל במבנה לטווח ארוך. לדוגמה, נעשה שימוש ב-LSTM ליצירת סולו ג'אז או בלוז על גבי רצף אקורדים נתון. עם זאת, האתגר של יצירת מוזיקה עם מבנה ארוך-טווח (כגון חזרתיות על מוטיבים ונושאים) נותר משמעותי גם עם התקדמות זו.[1]

GAN

ערך מורחב – GAN (למידה חישובית)

ערך מורחב – GAN (למידה חישובית)

רשתות GAN משמשות בתחום האודיו בעיקר ליצירת גלי קול גולמיים באיכות גבוהה ולסינתזה של דיבור ומוזיקה. הספרות המקצועית מצביעה על שימוש ברשתות GAN למטרות "נאמנות גבוהה למקור", כמו במודל HiFi-GAN שנועד לסינתזת דיבור יעילה ואיכותית, או Parallel WaveGAN ליצירת גלי קול מהירה. כמו כן, טכנולוגיה זו משמשת להמרה של קול שירה ולשיפור איכות הסאונד.[7]

טרנספורמרים

ערך מורחב – טרנספורמר (למידת מכונה)

ערך מורחב – טרנספורמר (למידת מכונה)

הכנסת ארכיטקטורת הטרנספורמר בשנת 2017 חוללה מהפכה בתחום המודלים הגנרטיביים. הטכנולוגיה, שעומדת בבסיס מודלים כמו GPT, מבוססת על מנגנון המכונה "Attention".[7][15]

יתרונות הטרנספורמר במבנה השיר הן מנגנון Attention המאפשר למודל להתייחס לכל חלקי הקלט ולזהות קשרים ותלויות גם במרחקים גדולים בתוך הרצף, ולא רק באופן סדרתי, התגברות על תלויות ארוכות טווח ועיבוד מקבילי.[7][15]

יישומים מרכזיים

הלחנה אוטומטית

הלחנה אוטומטית (אנ') היא תחום המשתמש באלגוריתמים ליצירת מוזיקה, החל ממנגינות פשוטות ועד יצירות הרמוניות מורכבות. התחום משלב עקרונות מתמטיים, מדעי המחשב ותיאוריה מוזיקלית כדי ליצור יצירות ללא התערבות אדם ישירה, או ככלי עזר ליוצרים אנושיים.

הרעיון של הלחנה אוטומטית אינו חדש. ההיסטוריה של יצירת מוזיקה אוטומטית עתיקה כמעט כמו המחשבים עצמם, ואף קדמה להם. כבר במאה ה-18, מוצרט ואחרים יצרו "משחקי קובייה מוזיקליים" (אנ'). במשחקים אלו, קטעי מוזיקה קטנים סודרו מחדש באופן אקראי על סמך הטלת קובייה כדי ליצור יצירה שלמה, מה שמהווה דוגמה מוקדמת לאלגוריתם המבוסס על אקראיות מבוקרת.[1][3] בשנת 1957, המחשב ILLIAC I שימש ליצירת "סוויטת איליאק", הנחשבת ליצירה הראשונה שהולחנה על ידי מחשב. מלחינים כמו הילר ואייזקסון השתמשו בכללים מתמטיים (כמו שרשראות מרקוב) כדי להנחות את המחשב בבחירת תווים.[1] בשנות ה-50, החוקרים הארי אף. אולסון (אנ') והרברט בלאר מ-RCA פיתחו "מכונת הלחנה" שניתחה סטטיסטית שירים של המלחין סטיבן פוסטר כדי לייצר שירים חדשים באותו סגנון, תוך שימוש בהסתברויות לבחירת הצלילים הבאים.[9] המלחין יאניס קסנאקיס השתמש בנוסחאות מתחום הפיזיקה (כגון התנהגות חלקיקי גז) כדי לקבוע פיזור של תווים וצלילים, גישה שיצרה "ענני צליל" מורכבים.[3]

המערכות להלחנה אוטומטית נשענות על מגוון טכניקות כדי לחקות יצירתיות או סגנונות מוזיקליים: מודלי מרקוב, אלגוריתמים גנטיים, מערכות מבוססות חוקים ולמידה עמוקה.[1][7]

הלחנה אוטומטית מתמודדת עם אתגרים שונים בהיבטים השונים של המוזיקה. המערכות מנסות ליצור רצפים המאזנים בין חזרתיות לבין חידוש. מודלים סטטיסטיים מתקדמים מנסים לחקות את הציפייה המלודית של המאזין. הלחנת הרמוניה (למשל, יצירת ליווי למנגינה קיימת) היא משימה נפוצה. מערכות רבות מתמקדות בהרמוניזציה, כאשר המטרה היא ליצור קולות ליווי שאינם מפרים חוקים מוזיקליים. אחד האתגרים הגדולים ביותר בתחום הוא יצירת יצירות בעלות מבנה הגיוני לאורך זמן (כגון חזרה על נושאים מוזיקליים, פיתוח וסיום). מודלים רבים מצטיינים ביצירת קטעים קצרים אך מתקשים לשמור על קוהרנטיות ביצירה ארוכה.[1]

לצד מערכות אוטונומיות לחלוטין, קיימת מגמה חזקה של מערכות אינטראקטיביות המסייעות ליוצרים: תוכנות כמו "Voyager" של המוזיקולוג האמריקאי ג'ורג' לואיס מאזינות לנגן אנושי ומאלתרות איתו בזמן אמת, כשהן מגיבות לקלט שלו אך גם פועלות לפי תהליכים פנימיים משלהן.[1] כלים כמו "Jukedeck" (שנרכשה על ידי בעלי טיקטוק) אפשרו למשתמשים להגדיר פרמטרים כמו "מצב רוח", סגנון ואורך, והמערכת הלחינה פסקול ייחודי לווידאו באופן מיידי.[17][13] שפות כמו ChucK (אנ') מאפשרות למלחינים-מתכנתים ליצור מוזיקה בזמן אמת (אנ') ולשנות את האלגוריתמים תוך כדי נגינה.[18]

יצירה אוטומטית אינה מסתכמת רק בתווים, אלא גם בהפקה. מערכת כמו "MEGAMI" משתמשת במודלים גנרטיביים כדי ליצור מיקסים של ערוצים נפרדים, בניסיון לחקות את הבחירות הסובייקטיביות של טכנאי סאונד אנושיים.[14]

עיצוב סאונד וסינתזה

ביישום זה עובר המיקוד אל הגוון המוזיקלי: חיקוי כלי נגינה וסינתזה, העברת גוון ועיצוב סאונד.

המטרה המרכזית בתחום חיקוי כלי נגינה וסינתזה היא ליצור צלילים שנשמעים כמו כלי נגינה אמיתיים או ליצור צלילים חדשים לחלוטין. מערכות מוקדמות ניסו לחקות גוון צליל על ידי השוואה של הספקטרום (ההרכב התדרים) של הצליל. מערכת בשם "SPORCH" (משנת 2003) ביצעה תזמור אוטומטי על ידי חיפוש במאגר של דגימות כלים כדי למצוא את השילוב שהכי קרוב לספקטרום של קובץ סאונד המהווה את המטרה. באופן דומה, מחקר מ-2005 השתמש בחיפוש איטרטיבי כדי למצוא כלים וירטואליים שיחקו גוון של דיבור אנושי על ידי מזעור ההבדלים במעטפת הספקטרלית.[1] כדי ליצור סינתזה משכנעת של כלי נשיפה, פותחה שיטה המבוססת על ההבנה שהתנהגות הכלי מאופיינת בעיקר על ידי המשרעת והתדר הבסיסי. המודל לוכד את הספקטרום בנקודות שונות ומבצע אינטרפולציה ביניהן כדי ליצור צליל רציף וטבעי. האתגר בסינתזה אינו רק יצירת גל הקול, אלא ה"נגינה" עליו. שיטות מסורתיות (כמו מעטפות ADSR) נשמעות מלאכותיות. מחקרים עדכניים השתמשו בלמידת מכונה כדי ללמוד כיצד נגנים אנושיים שולטים בעוצמה ובגובה הצליל בהתאם להקשר המוזיקלי.[5]

"העברת גוון" היא היכולת לקחת את המאפיינים האקוסטיים של צליל אחד ולהחיל אותם על צליל אחר (למשל, להפוך הקלטה של שריקה לצליל של כינור, או לשנות את זהות הדובר). אחת הדוגמאות הבולטות והשנויות במחלוקת לסינתזת גוון היא היכולת לחקות קולות אנושיים ספציפיים. הדוגמה של הראפר דרייק, שהשתמש ב-AI כדי ליצור דיפ-פייק של קולותיהם של טופאק שאקור וסנופ דוג בשיר "Taylor Made Freestyle", ממחישה את היכולת של הטכנולוגיה לסנתז ניואנסים של קול אנושי מוכר עד כדי כך שקשה להבחין בינו לבין המקור.[9] מערכות טקסט-לדיבור מתקדמות משתמשות במודלים של דיפוזיה כדי להשיג איכות זו.[7]

רבים מהמודלים הגנרטיביים המודרניים למוזיקה משתמשים בשכבות רשת קונבולוציה כדי לייצר את גל הקול הסופי. מחקר משנת 2025 חשף כי ארכיטקטורה זו משאירה "חתימה" ייחודית בספקטרום התדרים של המוזיקה – ארטיפקטים בתדרים גבוהים המכונים "תבנית לוח שחמט". תופעה זו נובעת מהאופן שבו המודל מבצע Upsampling וניתנת לזיהוי מתמטי.[8] מאידך, טכנולוגיה כמו מודל דיפוזיה, ששימשה במקור ליצירת תמונות, הוסבה ליצירת סאונד. המודל לומד "לנקות" רעש בהדרגה עד לקבלת ספקטרוגרמה או גל קול נקי, המייצג את הגוון הרצוי.[14][7]

מיקסינג ומאסטרינג אוטומטי

מיקסינג (אנ') ומאסטרינג אוטומטי הם יישומים שנועדו לקחת ערוצי נגינה נפרדים ולשלב אותם לכדי יצירה סופית ומגובשת, או לשפר קובץ שמע קיים לרמה מקצועית. המערכות האוטומטיות מבצעות מניפולציות על האות כדי להשיג איזון טכני ואסתטי. הפעולות המרכזיות כוללות:[14]

- איזון תדרים (אנ'): תיקון והתאמה של הספקטרום התדרי כדי למנוע התנגשויות בין כלים שונים.

- שליטה בדינמיקה: צמצום הפערים בין החלקים החלשים לחזקים באות כדי ליצור סאונד יציב יותר.

- עיצוב המרחב: קביעת המיקום של כל צליל בשדה הסטריאופוני (ימין/שמאל) והוספת תחושת חלל ועומק באמצעות הדהוד.

- ניתוח מאפיינים: המערכות מבססות את החלטותיהן על חילוץ מאפיינים כגון עוצמה ממוצעת (RMS), גורם קרסט (אנ'), רוחב הסטריאו ואיזון העוצמות בין הערוצים.

מיקסינג אינו רק הליך טכני, אלא משימה סובייקטיבית במהותה. עבור אותו סט של ערוצים גולמיים, ייתכנו מספר תוצאות סופיות שונות שכולן נחשבות "נכונות" וטובות, בהתאם לבחירות האומנותיות ולסגנון ההפקה. כלים רבים בתחום זה (הפועלים כמודלי רגרסיה) נוטים לעיתים להתעלם מהמגוון הזה ולייצר תוצאה שהיא מעין "ממוצע" של כלל הדוגמאות עליהן אומנו, מה שעלול להוביל למיקסים שמרניים מדי. פתרונות מתקדמים יותר מנסים לא רק "לאזן" את הסאונד, אלא ללמוד וליישם סגנונות הפקה ספציפיים על התוכן המוזיקלי מבלי לפגוע בו.[14]

הפרדת מקורות

יישום של בינה מלאכותית המתמקד ב"הבנת" אות האודיו, במטרה לפרק יצירה מוזיקלית קיימת ומוגמרת (מיקס) בחזרה למרכיביה הבודדים. המערכת מבצעת ניתוח אקוסטי של האות כדי לבודד מקורות צליל שונים מתוך תערובת פוליפונית.[2] בניגוד למערכות גנרטיביות שיוצרות יש מאין, כאן המטרה היא זיהוי והפרדה של שכבות קיימות, כאשר הסכום של כל הערוצים המופרדים אמור לשחזר את המיקס המקורי

דוגמה בולטת ליישום זה היא עבודתו של הבמאי פיטר ג'קסון על שירו של ג'ון לנון. הצוות השתמש בבינה מלאכותית כדי לבודד את קולו של לנון מתוך קלטת דמו ישנה, תוך הסרת רעשי הרקע, מה שאפשר את יצירת השיר "החדש" של הביטלס.[9] מפיקים משתמשים בכלים אלו כדי לחלץ אלמנטים ספציפיים משירים קיימים. למשל, משתמשים תיארו כיצד הם לוקחים שיר שנוצר בכלי בינה מאלכותית אחד, ומבצעים עליו "הפרדת ערוצים" (אנ') כדי לחלץ רק את ערוץ השירה ה"נקי" ולשלב אותו בתוך הפקה חדשה לגמרי בתוכנה אחרת.[19] היכולת הזו הופכת להיות חלק אינטגרלי מתוכנות עריכה מקצועיות. למשל, תוכנת Logic Pro של אפל הטמיעה פיצ'רים המאפשרים לפרק קובץ אודיו ולערוך כל כלי בנפרד.[9]

המלצות מוזיקה

המלצות מוזיקה וניתוח טעם המשתמש נשענים על תחום מחקר ופיתוח הנקרא איחזור מידע מוזיקלי (אנ') (באנגלית: Music Information Retrieval - MIR). מטרת העל של יישום זה היא להפוך כמויות עצומות של נתונים מוזיקליים (אודיו, ייצוגים סמליים ומידע נלווה) לנגיש, כך שניתן יהיה לחפש בתוכן, להמחיש אותו ויזואלית, ובעיקר להמליץ עליו למאזינים.[20]

האלגוריתמים מתמודדים עם אתגר המכונה "הפער הסמנטי" (אנ'). זהו הפער שבין המידע הפיזיקלי הגולמי שנמצא בקובץ האודיו לבין המושגים המוזיקליים הגבוהים שמעניינים את המאזין האנושי. המערכת מחלצת מאפיינים "נמוכים" מתוך גלי הקול, כגון ספקטרום התדרים, קצב חציית האפס (אנ') ומקדמי MFCC (אנ'). באמצעות טכניקות של למידת מכונה (כגון סיווג), האלגוריתמים מתרגמים את המאפיינים הטכניים הללו למושגים בעלי משמעות עבור המאזין, כגון סוגה, מצב רוח, זיהוי כלי נגינה וזיהוי אמנים.[20]

בנוסף לניתוח הצליל עצמו, מערכות ההמלצה מסתמכות על ניתוח מידע טקסטואלי ו"תגיות חברתיות". היישום מנתח תגיות טקסט חופשי שמשתמשים מצמידים לתוכן בשירותי מוזיקה (כגון Last.fm). תגיות אלו מסייעות למערכת לקשר בין שירים על בסיס תפיסות סובייקטיביות או תרבותיות של המאזינים, ולא רק על בסיס הניתוח האקוסטי היבש.[20]

השפעה על תעשיית המוזיקה

דמוקרטיזציה של היצירה

דמוקרטיזציה של היצירה היא אחד ההיבטים המשמעותיים והמדוברים ביותר של מהפכת הבינה המלאכותית במוזיקה. המשמעות היא הפיכת תהליך היצירה, שהיה שמור בעבר לקבוצה מצומצמת של בעלי הכשרה, כישרון ומשאבים, לנגיש עבור הציבור הרחב.

החסם הטכני והתאורטי ליצירת מוזיקה הוסר כמעט לחלוטין באמצעות מודלים גנרטיביים חדשים. כיום, אנשים יכולים ליצור מוזיקה פשוט באמצעות מילים. מודלים כמו Suno, Udio ו-MusicLM מאפשרים למשתמשים להקליד הנחיות טקסטואליות – כגון סגנון, מצב רוח, או מילים לשיר, והמערכת מייצרת שיר מלא, כולל שירה, בתוך שניות.[9][7][6] המשתמשים אינם צריכים לדעת לקרוא תווים, לנגן על כלי נגינה, או להבין בהפקה מוזיקלית כדי ליצור יצירה שנשמעת מקצועית. בכך, הטכנולוגיה מגשימה את הרעיון שמוזיקה היא "שפה אוניברסלית" שבה כל אחד יכול "לדבר".[9] מייסד חברת Popgun השווה את המהפכה הזו למה שעשתה אינסטגרם לצילום: כפי שהיא הפכה כל אחד לצלם, הבינה המלאכותית מאפשרת לכל אחד ליצור "מוזיקה שנשמעת טוב וראויה לשיתוף".[21]

השימוש בבינה מלאכותית משנה את אופי האינטראקציה עם המוזיקה. במקום לבנות את היצירה תו-תו, המשתמש הופך ל"נווט" או "במאי". ג'ון קייג' ציין שהעבודה עם מחשבים משנה את הפרדיגמה ממצב של "מחסור" למצב של "שפע", שבו המחשב מציע אפשרויות רבות והאדם בוחר מתוכן. המלחין יאניס קסנאקיס תיאר את המלחין בעידן המחשב כ"טייס" המזין קואורדינטות ומפקח על הבקרים של חללית המשייטת במרחב הצלילי.[3] טכנולוגיה זו פתחה דלתות גם עבור אנשים עם מוגבלויות פיזיות שמונעות מהם לנגן בכלים מסורתיים, ומאפשרת להם לעסוק ביצירה.[9]

לצד ההתלהבות, קמו גם חששות ותופעות לוואי של הורדת רף הכניסה. קיים חשש כי הצפה של יצירות בינה מלאכותית תוביל ל"זומביפיקציה" של האמנות – יצירות בינוניות המחקות סגנונות עבר ללא חידוש אמיתי, מה שעלול לדלל את החדשנות הקולקטיבית.[15] משתמשים בפלטפורמות כמו Suno ו-Udio מדווחים לעיתים על תחושה שהשירים "לא באמת שלהם", ומתקיים דיון ער על ההבדלים באיכות הסאונד וב"אנושיות" של הקולות בין הפלטפורמות השונות.[19] כמו כן, החוק בארצות הברית דורש כיום מעורבות אנושית משמעותית כדי להעניק זכויות יוצרים, מה שמותיר יצירות שנוצרו בלחיצת כפתור (ללא עריכה נוספת) מחוץ להגנת זכויות היוצרים.[16]

עלייתם של אמנים בסיוע בינה מלאכותית באה לידי ביטוי בחתימתה של חברת Hallwood Media של קסניה מונה (אנ'), זמרת שנבנתה בידי היוצרת טאלישה ג'ונס באמצעות Suno; תופעה זו לובתה גם בחתימת החברה על האמן imoliver.[22]

מוזיקה פונקציונלית

מוזיקה פונקציונלית (אנ') היא אחד התחומים שבהם הבינה המלאכותית מחוללת את השינוי הכלכלי והמעשי המיידי ביותר. הכוונה היא למוזיקה שאינה בהכרח מיועדת להאזנה ממוקדת כיצירה אומנותית, אלא כזו שנועדה לשרת מטרה: ליווי, יצירת אווירה, הגברת ריכוז או תמיכה במדיה אחרת. תחום זה מתאפיין במעבר מיצירה ידנית לייצור המוני, זול ומותאם אישית, והוא משפיע על מספר סקטורים מרכזיים.

הצורך הגובר בתוכן וידאו (יוטיוב, טיקטוק, פרסומות) יצר ביקוש למוזיקת רקע זולה ופטורה מתמלוגים. בעבר, יוצרי וידאו נאלצו לסרוק ספריות מוזיקה כדי למצוא רצועות גנריות ולהתמודד עם רישוי יקר. חברות בינה מלאכותית כמו "Jukedeck" ו-"Amper" פיתחו מערכות המאפשרות למשתמש לבחור פרמטרים כמו "מצב רוח", סגנון, מקצב ואורך מדויק. המערכת מייצרת יצירה ייחודית בתוך שניות, שהיא לרוב פטורה מתמלוגים ומותאמת בדיוק לצרכי הסרטון.[17][13] המטרה המוצהרת של כלים אלו היא "לתת לכל אדם בעולם מלחין משלו", מה שמאפשר גם למי שאין לו רקע מוזיקלי ליצור פסקול מקצועי בעלות נמוכה מאוד.[17] מייסד חברת "Amper" הגדיר את הטכנולוגיה לא כ"כלי מוזיקלי" אלא כ"כלי התייעלות". עבור מוזיקת רקע פונקציונלית (כמו מוזיקת מעליות או רקע לוידאו הסברתי), המשתמש מעדיף פתרון מהיר וזול על פני יצירה אנושית מושקעת.[21]

במשחקי מחשב, המוזיקה צריכה להגיב בזמן אמת להתרחשויות על המסך. באופן מסורתי, משחקים השתמשו בטכניקות של עמעום ומעבר בין קובצי אודיו מוכנים מראש. כיום, מערכות בינה מלאכותית מאפשרות יצירה דינמית המשתנה בהתאם למצב המשחק ולפעולות השחקן, ללא החזרתיות של לופים קבועים. מחקרים בתחום מנסים ליצור מערכות המבינות "נרטיב" ו"מתח". המערכת יכולה לזהות את רמת הסכנה במשחק ולהתאים את המוזיקה כדי לעורר את הרגש המתאים אצל השחקן, תוך שימוש בטכניקות של הלחנה אוטומטית המבוססות על פרופילי מתח. למשל, המלחין בריאן אינו שיתף פעולה עם יצרני המשחק "ספור" ליצירת פסקול שמשתנה על בסיס סגנון המשחק של המשתמש.[1]

מוזיקת אמביינט הינו אחד התחומים בעלי הפוטנציאל הכלכלי הגדול ביותר עבור פלטפורמות הסטרימינג. קיים חשש ששירותי סטרימינג כמו ספוטיפיי ישתמשו בבינה מלאכותית כדי לייצר אלפי שעות של מוזיקת "רגיעה" או מוזיקת רקע לעבודה. מכיוון שהמוזיקה מיוצרת על ידי האלגוריתם, הפלטפורמה לא תצטרך לשלם תמלוגים למלחינים אנושיים, מה שיחסוך להן עלויות עצומות.[21] אפליקציות כמו "Endel" יוצרות "מרחבי סאונד" אינסופיים המותאמים אישית למשתמש לצורכי הרגעת מתחים, שינה או ריכוז. האלגוריתם מייצר את המוזיקה בזמן אמת בהתאם לנתונים כמו השעה ביום, מזג האוויר או הדופק של המשתמש.[13]

שינוי תפקיד המפיק

השימוש בבינה מלאכותית בתעשיית המוזיקה מוביל לשינוי פרדיגמה יסודי בתפקיד המפיק והיוצר. המעבר מ"כתיבה" ל"אוצרות" משנה את הדינמיקה היצירתית מפעולה של בנייה ידנית לפעולה של בחירה, ניווט וניהול של אפשרויות.

אחד השינויים הפילוסופיים והמעשיים העמוקים ביותר הוא המעבר ממצב שבו על המלחין לקבל החלטה אחת בכל רגע נתון, למצב שבו המערכת מציעה אפשרויות רבות. ג'ון קייג' תיאר זאת כבר בשנות ה-60, כאשר אמר שהעבודה עם מחשבים משחררת את היוצר מהצורך "להגביל את עצמו לרעיון אחד". השינוי הוא מ"השפעות של מחסור" ל"השפעות של שפע", ואף "בזבוז" – היכולת לייצר המון ולזרוק את מה שלא מתאים.[3] בפועל, משתמשים במערכות מודרניות כמו Suno ו-Udio מדווחים על יצירת אלפי שירים כדי לשמור רק בודדים שהם "טובים באמת". התהליך מתואר כ"הגרלה" או "סינון זהב", שבו רוב התוצרים נזרקים, והמפיק מחפש את היהלום שבערמה.[19][21]

במקום להיות האומן היוצר, המפיק הופך למפעיל מערכת המנווט את היצירה מלמעלה. המלחין יאניס קסנאקיס דימה את המלחין בעידן המחשב ל"טייס" המזין קואורדינטות, לוחץ על כפתורים ומפקח על הבקרים של "חללית המשייטת במרחב הצלילי". המוזיקאי בריאן אינו תיאר את תהליך העבודה שלו עם מערכות גנרטיביות כמעבר לתפקיד של "מתכנן", שלאחר מכן הופך להיות חלק מהקהל המאזין לתוצאות שהמערכת יצרה, עם מינימום התערבות ידנית.[3] המפיק בנואה קארה (צר'), שעבד עם מערכת Flow Machines, תיאר את תפקידו כ"מנהל אומנותי" הבוחר מתוך האפשרויות שהמכונה מציעה, שלעיתים הן "זבל" אך לעיתים מפתיעות וחדשניות.[21]

היצירה אינה מתחילה ב"דף ריק" אלא בדיאלוג עם המכונה, המבוסס על בחירה מתוך היצע: היצירתיות האנושית באה לידי ביטוי בשלב הראשון בניסוח ההנחיה הטקסטואלית (הגדרת המטרה, הסגנון והפרמטרים).[15][9] המשתמש משכלל את הבקשות כדי לכוון את המערכת לתוצאה הרצויה.[9] במערכות כמו Udio, המשתמשים בונים שיר על ידי בחירת "גושים"של 32 שניות. הם בוחרים את הקטע הטוב ביותר, מאריכים אותו, וחוזרים חלילה. המשתמש פועל כעורך שבורר את הנתיב המוזיקלי המוצלח ביותר מתוך האפשרויות.[19] מכיוון שהמערכת יכולה לייצר וריאציות אינסופיות, התפקיד הקריטי של האדם הוא השיפוט – היכולת להבחין בין תוצר בינוני לתוצר מרגש, ולזהות "תאונות מוצלחות" שהאלגוריתם יצר.[21]

המעבר לתפקיד ה"אוצר" מעורר שאלות משפטיות ופילוסופיות לגבי מהות ה"מחבר". החוק המסורתי דורש שהיצירה תהיה "פרי עמלו" של אדם. כאשר הבינה המלאכותית מבצעת את רוב העבודה הטכנית, מתעורר וויכוח האם פעולת הבחירה והסידור של המשתמש מספיקה כדי להעניק לו זכויות יוצרים.[9][15] הטענה היא שאם המשתמש מבצע בחירות יצירתיות משמעותיות מתוך ההיצע של המכונה, או עורך את התוצרים באופן מקורי, הוא עדיין יכול להיחשב כיוצר, בדומה לצלם שבוחר את הקומפוזיציה והרגע הנכון, גם אם המצלמה מבצעת את הפעולה הטכנית של רישום התמונה.[9]

סוגיות אתיות ומשפטיות

זכויות יוצרים

סוגיית זכויות היוצרים במוזיקת AI היא אחת המורכבות והבוערות ביותר בעולם המשפט והטכנולוגיה. היא מתחלקת לשני צדדים עיקריים: מעמדו של התוצר ומעמדו של הקלט.

הגישה הרווחת כיום בארה"ב ובישראל היא שיצירה שנוצרה באופן מלא על ידי בינה מלאכותית אינה זכאית להגנת זכויות יוצרים.[15] משרד זכויות היוצרים האמריקאי (אנ') הבהיר בדוח מינואר 2025 ובפסיקות קודמות כי החוק מחייב שהיצירה תכלול "תרומה אנושית מקורית".[16][15] יצירות שנוצרו ללא התערבות אנושית מוגדרות כנחלת הכלל.[16] קיימת מחלוקת האם כתיבת הפרומפט נחשבת ליצירה. העמדה הרשמית של משרד זכויות היוצרים האמריקאי היא שפרומפט דומה יותר ל"הוראה" או "רעיון" מאשר לביטוי יצירתי, ולכן אינו מספיק כדי להקנות זכויות יוצרים על התוצר. עם זאת, ישנם הטוענים כי תהליך של "הנדסת פרומפטים", הכולל שרשרת של בחירות ועיבוד, צריך להיחשב כפעולת עריכה המקנה זכויות יוצרים רזות (על הבחירה והעיבוד בלבד).[9] יצירה המשלבת בינה מלאכותית עם עריכה אנושית משמעותית עשויה לקבל הגנה חלקית. ההגנה תחול רק על החלקים האנושיים, אך לא על החלקים שנוצרו גנרטיבית על ידי המכונה.[16][9]

מאחר שהחוק המסורתי מתקשה להכיל יצירות מכונה, הספרות המשפטית והמודלים העסקיים מציעים מספר גישות לגבי זהות הבעלים הפוטנציאלי. הטיעון בעד המשתמש הוא שהדבר מעודד יצירתיות, דמוקרטיזציה של היצירה ומונע ריכוזיות כוח אצל חברות הטכנולוגיה.[15] פלטפורמות כמו Udio ו-Suno מעניקות למנויים משלמים את הזכויות המסחריות בתוצרים (באופן חוזי), בעוד משתמשים חינמיים נדרשים לתת קרדיט.[19] הטיעון בעד המפתחים והחברות הוא שיש לתגמל את ההשקעה העצומה בפיתוח האלגוריתם והמשאבים. גישה זו רואה במשתמש כמי שרק לוחץ על כפתור, בעוד ה"כישרון" האמיתי טמון בקוד.[15] גישה תיאורטית נוספת מציעה להכיר בבינה המלאכותית כיוצרת. בתי המשפט דחו גישה זו, בטענה שלמכונה אין אישיות משפטית, היא אינה זקוקה לתמריץ ליצור, ואינה יכולה להיות בעלת זכויות וחובות.[15] גישה נוספת גורסת כי בהעדר "ניצוץ אנושי", יצירות אלו שייכות לציבור. זהו הפתרון המשפטי הנוכחי לגבי תוצרים "טהורים" של בינה המלאכותית, והוא נתמך בטיעון שזה יעודד חדשנות וימנע חסמים משפטיים.[15]

חזית נוספת היא העובדה שחברות הבינה המלאכותית מאמנות את המודלים שלהן על מיליארדי יצירות, לרוב ללא רשות מפורשת. בשנת 2025 שלוש חברות התקליטים הגדולות (וורנר, יוניברסל וסוני) הגישו תביעה בסך 500 מיליון דולר נגד חברות יצירת המוזיקה Suno AI ו-Udio, בטענה להפרת זכויות יוצרים בקנה מידה נרחב; מאוחר יותר וורנר ויוניברסל הגיעו להסכמות חלקיות עם Udio ו-Suno. ההסדרים המשפטיים הובילו להגבלות חדשות על שימוש במוזיקה שנוצרת בפלטפורמות הבינה המלאכותית, ובהן מניעת הוצאת תוצרים אל מחוץ לפלטפורמה ומתן תגמול ליוצרים המאפשרים שימוש בקטלוגים שלהם.[22] חברות הטכנולוגיה טענו שאימון המודל הוא "שימוש הוגן" מכיוון שהוא טרנספורמטיבי – הוא לומד עקרונות ודפוסים כדי ליצור משהו חדש, ולא מעתיק את היצירה.[9][16] במקביל - בתי המשפט בארצות הברית החלו לשרטט גבולות. בתיק "Thomson Reuters v. Ross Intelligence" משנת 2025 נקבע שאימון AI על תוכן מוגן אינו נחשב לשימוש הוגן אם הפלט מתחרה ישירות ביצירה המקורית.[16]

דיפ-פייק קולי

השיר "Heart on My Sleeve" (שחיקה את דרייק ודה ויקנד) היה הסנונית הראשונה שעוררה סערה ציבורית. לאחר מכן, בשנת 2024, דרייק שחרר שיר בשם "Taylor Made Freestyle" כחלק מסכסוך מתוקשר עם הראפר קנדריק לאמאר. בשיר זה, דרייק השתמש בבינה מלאכותית כדי לחקות את קולותיהם של הראפר המנוח טופאק שאקור ושל סנופ דוג, וגרם להם "לומר" טקסטים שהוא כתב נגד לאמאר. השימוש בקולו של טופאק עורר זעם מצד עיזבונו של המנוח, ששלח לדרייק מכתב התראה בגין פגיעה בזכות הפרסום, מה שאילץ את דרייק להסיר את השיר. מקרה זה, לצד המקרה של סקרלט ג'והנסון ו-OpenAI, המחיש את הקלות שבה ניתן "לגנוב" זהות קולית.[9]

הבעיה המרכזית היא שחוק זכויות היוצרים המסורתי אינו מגן על "קול" או על "סגנון שירה" בפני עצמם. זכויות יוצרים מגינות על יצירות ספציפיות (הלחן, המילים) ועל הקלטות ספציפיות, אך הן אינן מעניקות לזמר בעלות על גוון הקול שלו. לכן, חיקוי קול באמצעות AI אינו נחשב בהכרח להפרת זכויות יוצרים קלאסית. ההגנה המשפטית העיקרית בארצות הברית מגיעה מכיוון "זכות הפרסום" (או העוולה הנזיקית של גניבת זהות/התחזות). פסיקה תקדימית בעניין הזמרת בט מידלר קבעה כי הקול האנושי הוא אחד הביטויים המובהקים ביותר של הזהות, ולכן חיקוי שלו לצורך מסחרי מהווה פגיעה בזהות הזמר.[9]

כדי לסגור את הפער הזה, מחוקקים בארצות הברית מקדמים חוקים ספציפיים כנגד זיופים קוליים:[9]

- חוק ה-ELVIS (אנ'): מדינת טנסי הייתה הראשונה לחוקק את ה-"ELVIS Act" ב-2024. החוק תיקן את חוק זכות הפרסום של המדינה כך שיכלול במפורש הגנה על "קול" מפני שימוש לא מורשה בטכנולוגיות AI. החוק מאפשר תביעה אזרחית נגד מי שמפיץ טכנולוגיה שמטרתה העיקרית היא חיקוי קול ללא אישור.

- חוק ה-NO FAKES (פדרלי): ברמה הפדרלית בארצות הברית, מקודמת הצעת חוק בשם "NO FAKES Act". הצעת החוק מבקשת ליצור זכות קניין פדרלית חדשה שתגן על הקול והדמות של כל אדם מפני שכפול דיגיטלי בלתי מורשה. החוק המוצע מטיל אחריות על מי שיוצר או מפיץ ביודעין זיוף דיגיטלי קולי.

מעבר לפגיעה הכלכלית באמנים, המקורות מציינים סכנות רחבות יותר לשימוש בטכנולוגיה זו, כמו הונאה ודיוג - היכולת לחקות קולות משמשת גורמים עוינים לביצוע הונאות, התחזות לבני משפחה או פוליטיקאים, וגניבת מידע.[7]

החשש מפגיעה בפרנסת מוזיקאים

החשש מפני פגיעה בפרנסתם של מוזיקאים והחלפתם על ידי תוכנה הוא אחד הנושאים הבוערים ביותר בדיון על בינה מלאכותית במוזיקה. בעוד שעבור סוגים מסוימים של מוזיקאים הסכנה מוחשית ומיידית, עבור אחרים הטכנולוגיה עשויה לשמש ככלי עזר או כמנוע לשינוי הקריירה.

התחום של "מוזיקה פונקציונלית" זהו התחום שנמצא בסיכון הגבוה ביותר להחלפה מיידית על ידי AI.[21] עם זאת, גם נגנים המבצעים הקלטות עבור הפקות של אחרים נתונים בפני שינוי דרמטי - תוכנות הפקה מתקדמות כמו Logic Pro כבר כוללות כלי AI המכונים "Session Players".[9] כלים אלו מאפשרים למפיק באולפן הביתי לייצר ליווי של כלים אקוסטיים (כמו תופים או קלידים) ברמה גבוהה, ללא צורך לשכור נגן אנושי. קיים חשש כי שילוב AI בכלים ומקלדות יוביל לכך שמוזיקאים צעירים יוותרו על הצורך להגיע לשליטה טכנית גבוהה בכלי הנגינה, מכיוון שהתוכנה תוכל להשלים או לתקן את הביצוע שלהם בזמן אמת.[21] מנכ"ל SoundExchange צפה עתיד שבו "אמנים וירטואליים", שקולם ושיריהם נוצרו לחלוטין על ידי AI, יתחרו באמנים אנושיים. חברות כבר מפתחות דמויות וירטואליות שיכולות "להופיע" ולשתף פעולה עם משתמשים, כאשר המודל העסקי מנסה לפצות את האמנים המקוריים עליהם התבסס המודל.[16]

ההערכה היא שה-AI יפגע בעיקר במוזיקאים בתחילת דרכם ובמלחינים ברמה הנמוכה, שהתפרנסו עד כה מעבודות פשוטות של מוזיקת רקע. לעומת זאת, הטכנולוגיה אינה מאיימת על הטאלנטים הבכירים שכותבים פסקולים מורכבים לסרטים או יוצרים שירים בעלי משמעות תרבותית ורגשית. מייסד חברת AI למוזיקה ניסח זאת כך: ”העבודה שלכם כמוזיקאים ומלחינים לא תהיה קיימת בעוד חמש שנים, אבל הקריירה שלכם בהחלט כן”.[21] הכוונה היא שהמוזיקאים יצטרכו להתמקד בניהול אומנותי, אוצרות, ושיתופי פעולה אנושיים שהבוטים לא יכולים לחקות. מוזיקאים עשויים למצוא מקורות הכנסה חדשים, כמו מכירת רישיונות לשימוש בקול שלהם עבור יצירות AI של מעריצים (כפי שעושה הזמרת גריימס או פלטפורמות כמו Hooky).[16][9]

ראו גם

קישורים חיצוניים

הערות שוליים

- ^ 1.00 1.01 1.02 1.03 1.04 1.05 1.06 1.07 1.08 1.09 1.10 1.11 1.12 1.13 1.14 1.15 1.16 1.17 1.18 1.19 1.20 1.21 1.22 1.23 1.24 1.25 1.26 1.27 1.28 1.29 1.30 1.31 1.32 1.33 1.34 Herremans, Dorien; Chuan, Ching-Hua; Chew, Elaine (2018-12-11), A Functional Taxonomy of Music Generation Systems, doi:10.48550/arXiv.1812.04186, נבדק ב-2025-12-06

- ^ 2.0 2.1 2.2 Research in music and artificial intelligence, dl.acm.org (באנגלית)

- ^ 3.00 3.01 3.02 3.03 3.04 3.05 3.06 3.07 3.08 3.09 3.10 3.11 3.12 3.13 3.14 Michael Edwards, Algorithmic Composition: Computational Thinking in Music DRAFT

- ↑ F. P. BROOKS, JR., A. L. HOPKINS, JR., P. G. NEUMANN, AND W. V. WRIGHT, AN EXPERIMENT IN MUSICAL COMPOSITION, 1957

- ^ 5.0 5.1 5.2 5.3 Roger B. Dannenberg, Artificial Intelligence, Machine Learning, and Music Understanding, School of Computer Science and College of Art Carnegie Mellon University (ארכיון)

- ^ 6.0 6.1 איך בינה מלאכותית משנה את פני המוזיקה – הצצה לעתיד היצירה וצריכת המוזיקה, באתר האוניברסיטה הפתוחה

- ^ 7.00 7.01 7.02 7.03 7.04 7.05 7.06 7.07 7.08 7.09 Julia Barnett, The Ethical Implications of Generative Audio Models: A Systematic Literature Review, Northwestern University, 2023

- ^ 8.0 8.1 8.2 Darius Afchar, Gabriel Meseguer-Brocal, Kamil Akesbi, Romain Hennequin, A Fourier Explanation of AI-music Artifacts, 2025-09-21. (באנגלית)

- ^ 9.00 9.01 9.02 9.03 9.04 9.05 9.06 9.07 9.08 9.09 9.10 9.11 9.12 9.13 9.14 9.15 9.16 9.17 9.18 9.19 9.20 9.21 9.22 Edward Lee, AI and the Sound of Music, Yale Law Journal, 2024-11-22 (באנגלית)

- ↑ Torsten Anders, Composing Music by Composing Rules: Design and Usage of a Generic Music Constraint System, Queen's University Belfast, 13 בפברואר 2007

- ↑ Staney Joseph 🎖️, The Interaction of Artificial Intelligence: How Terry Winograd Designed the SHRDLU Program, Medium, 2023-10-30 (באנגלית)

- ↑ Samuel Fishwick, Jukedeck uses machine learning to make sweet harmonies, The Standard, 2018-03-01 (באנגלית)

- ^ 13.0 13.1 13.2 13.3 Tim Ingham, TikTok owner Bytedance buys AI music company Jukedeck, Music Business Worldwide, 2019-07-23 (באנגלית אמריקאית)

- ^ 14.0 14.1 14.2 14.3 14.4 AUTOMATIC MUSIC MIXING USING A GENERATIVE MODEL OF EFFECT EMBEDDINGS, Sony AI, 11 בנובמבר 2025

- ^ 15.00 15.01 15.02 15.03 15.04 15.05 15.06 15.07 15.08 15.09 15.10 15.11 אייל ברוק, זכויות יוצרים, בינה מלאכותית והאופי המשתנה של הליך היצירה, באתר אוניברסיטת תל אביב

- ^ 16.0 16.1 16.2 16.3 16.4 16.5 16.6 16.7 16.8 קרן שחר, המסגרת הרגולטורית של יצירה מוזיקלית בעידן ה-AI, באתר ynet, 13 באפריל 2025

- ^ 17.0 17.1 17.2 Josh Constine, Need Music For A Video? Jukedeck's AI Composer Makes Cheap, Custom Soundtracks, TechCrunch, 2015-12-07 (באנגלית אמריקאית)

- ↑ ChucK Team, ChucK: A Strongly-Timed Music Programming Language, ccrma.stanford.edu (באנגלית)

- ^ 19.0 19.1 19.2 19.3 19.4 COMPARISON: Suno Vs Udio. My opinion after using both a LOT..., Reddit

- ^ 20.0 20.1 20.2 Rebecca Fiebrink, Ge Wang & Perry R. Cook, FOUNDATIONS FOR ON-THE-FLY LEARNING IN THE CHUCK PROGRAMMING LANGUAGE

- ^ 21.0 21.1 21.2 21.3 21.4 21.5 21.6 21.7 21.8 Clive Thompson, What will happen when machines write songs just as well as your favorite musician?, Mother Jones (באנגלית אמריקאית)

- ^ 22.0 22.1 Dan Rys, The 10 Biggest Record Label Stories of 2025, Billboard, 2025-12-01 (באנגלית אמריקאית)

בינה מלאכותית במוזיקה42363272Q16254165